AI 产品日报 | 2026-05-14

🔬 422产品实验室 · AI新产品日报 · 每日精选

今日洞察

今天最强烈的信号是「AI模型极致压缩」正在从实验室走向生产。Needle以637个HN赞证明了:Gemini的Tool Calling能力可以被蒸馏进一个26M参数的「简单注意力网络」——不需要GPU,手机上就能以6000 tok/s的速度运行。这意味着Agent的「大脑」(推理)和「手」(工具调用)正在拆分成两个独立的、可独立部署的组件。

与此同时,Agent基础设施继续向「深度专业化」分化:Statewright用Rust状态机引擎让Agent「不能犯错」而非「尽量不犯错」;E2a为Agent建了一个带认证的邮件系统;Hopper把Agent引入了最古老的计算遗产——大型机COBOL系统;HookGuard则扫描Agent配置文件里的恶意指令。Gigacatalyst让SaaS用户(非技术人员)用自然语言就能给产品「加装」新功能。

对创业者来说,今天的核心判断是:Agent基础设施的「通用层」已经拥挤,但「极端专用层」才刚刚开始——给Agent造专用浏览器、专用邮件网关、专用状态机、专用安全扫描器,每一个都是一个独立的品类。

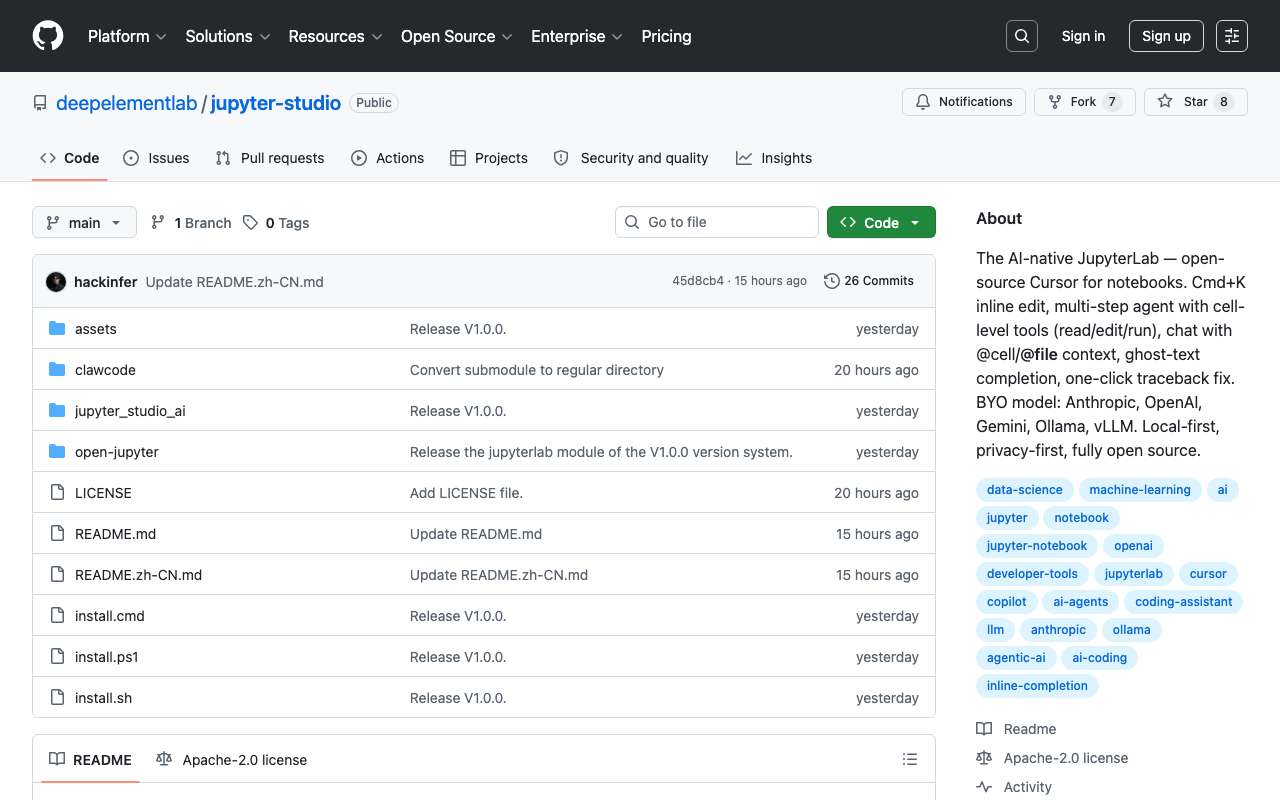

1. Needle — 把Gemini工具调用蒸馏进26M参数,手机上6000 tok/s运行(HN 637pts)

融资信息:开源项目(Apache 2.0),Cactus-Compute团队出品,16块TPU v6e训练27小时

做什么的:将Gemini 3.1的工具调用(Function Calling)能力蒸馏为26M参数的「简单注意力网络」(Simple Attention Network)——encoder 12层+decoder 8层,无FFN,支持本地微调。在生产环境中通过Cactus引擎运行,预填充6000 tok/s,解码1200 tok/s。

为什么值得关注:

– 637个HN赞——本周AI项目最高分之一。核心突破不在于模型大小,而在于架构创新:去掉FFN层,用Cross-Attention连接encoder-decoder,用ZCRMSNorm替代LayerNorm。这是一个「少即是多」的架构设计哲学

– 200B token预训练 + 2B token工具调用后训练 = 27小时 + 45分钟:训练成本极低。这说明「专用微型模型」的商业可行性——不需要数百万美元的训练成本,几个小时就能出一个生产级模型

– 击败FunctionGemma-270m、Qwen-0.6B等更大模型:在单次工具调用任务上,26M参数的Needle超越了270M甚至600M参数的模型。这证明了「领域蒸馏」比「通用缩放」更高效

– 本地微调一条命令:needle playground 打开Web UI,用Gemini自动生成训练数据,一键微调。开发者可以为特定API结构定制工具调用模型

– 创业者启示:「把大模型的一个特定能力蒸馏到极致」是一个商业模式。Needle证明了工具调用这个能力可以用26M参数独立解决,不需要依赖几百亿参数的通用模型。同样的思路可以复制到:意图识别(5M就够了?)、实体抽取(10M?)、情感分析(3M?)——每个被蒸馏出来的「微型专家」都可以独立部署和收费

类比参考:AI Agent的「运动皮层」——Agent的大脑(LLM推理)可以很大,但「动手调用工具」这个动作只需要26M参数的专用模块。或者「LLM版的RISC-V:极简指令集,极致效率」

🔗 GitHub | HuggingFace

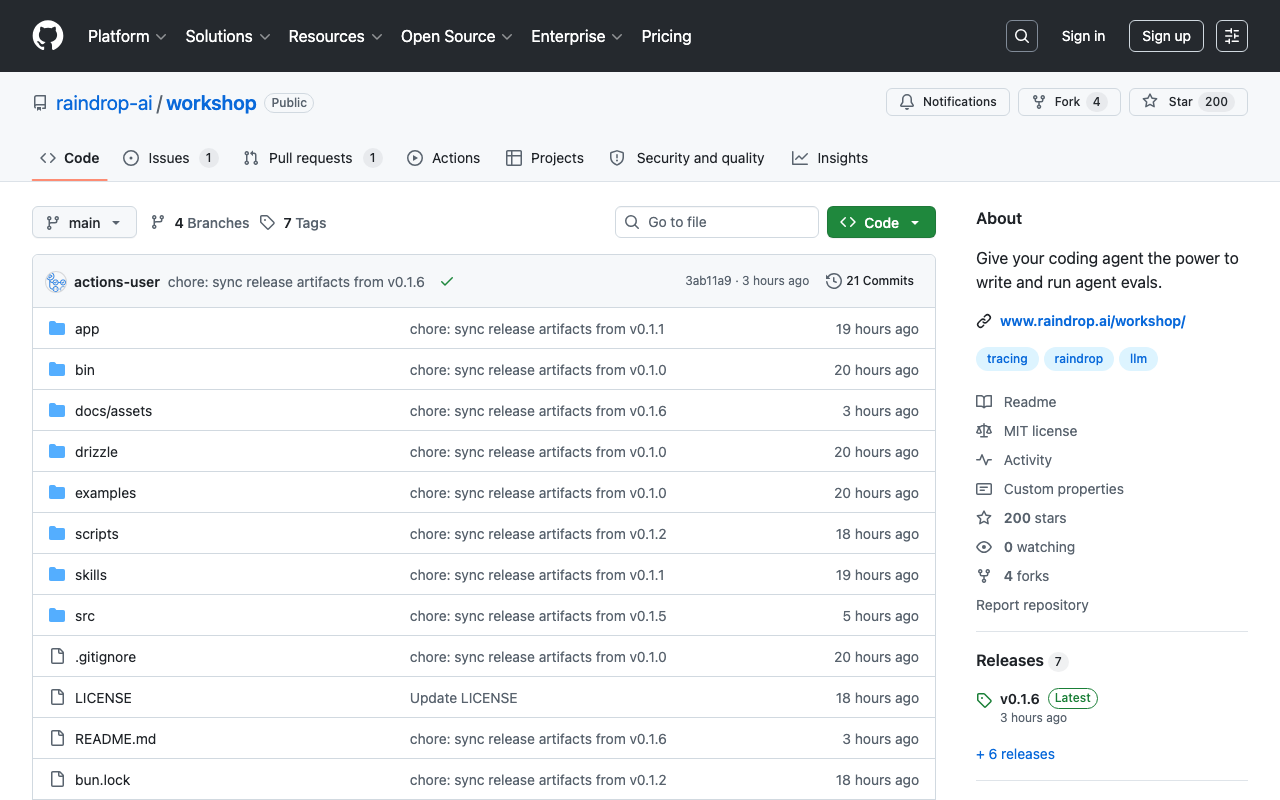

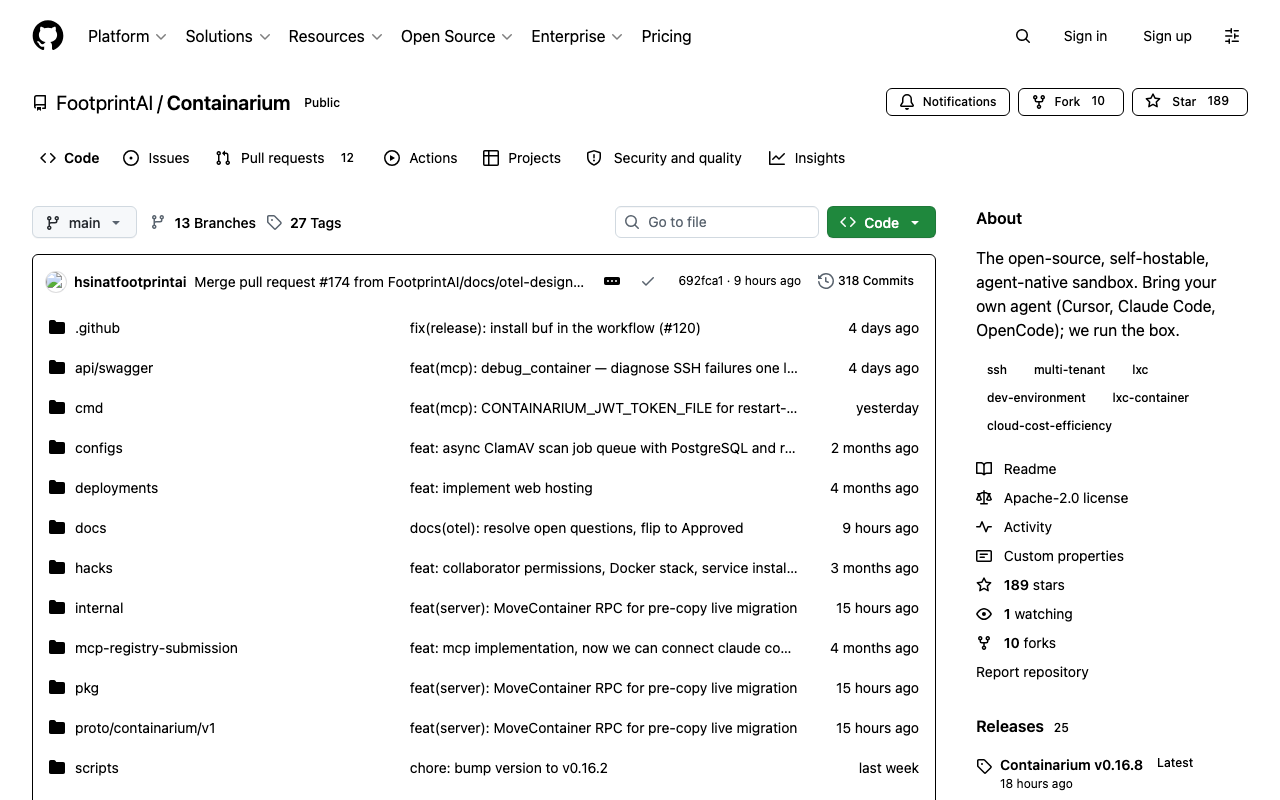

2. Statewright — 用状态机让AI Agent「不能犯错」,而非「尽量不犯错」(HN 112pts)

融资信息:开源项目,核心引擎Apache 2.0,插件FSL 1.1,已申请临时专利

做什么的:为AI Agent构建可视化状态机引擎——用Rust编写的确定性状态机在每个阶段限制Agent可用的工具、迭代次数和合法转换。不是用prompt告诉Agent「应该做什么」,而是用代码强制Agent「只能做什么」。通过MCP插件与Claude Code集成。

为什么值得关注:

– 「Agents are suggestions, states are laws」——这句话精准概括了产品哲学:传统方式是用越来越长的prompt约束Agent行为。Statewright的思路是:把约束从prompt层移到协议层。模型不能跳过测试阶段直接部署,因为状态机根本不提供这个转换路径

– 13B参数以上的模型+状态机 = 可靠的编码Agent:作者在SWE-bench上验证:用qwen-coder、gemma4等13-20B参数模型配合状态机,效果甚至优于不加约束的更大模型。关键洞察是「上下文窗口利用率比原始大小更重要」

– 可视化编辑器:不是写YAML/JSON定义状态机,而是通过statewright.ai的图形界面拖拽节点、定义转换和守卫条件。失败路径、重试循环、审批门——都能看见

– 对前沿模型同样有效:Haiku和Sonnet配合状态机后「punch above their weight」,Opus「solves more reliably with fewer tokens and death spirals」

– 创业者启示:「用确定性代码约束非确定性模型」是一个被低估的技术路线。大多数人试图让模型更可靠(更大的模型、更长的prompt),Statewright证明了另一个路径:让模型在更小的解空间里工作。这个思路可以延伸到任何需要Agent可靠执行的场景——金融交易、法律文书、医疗诊断

类比参考:AI Agent版的「流水线+质检门」——不是告诉工人「请认真点」,而是设计一个工人不可能跳过质检步骤的生产线。或者「自动驾驶的硬约束安全层,但用于Agent」

3. Hypercubic Hopper — AI Agent操作大型机,把COBOL专家知识装进AI(HN 89pts)

融资信息:Hypercubic公司出品,商业产品,已有零售/航空客户

做什么的:为z/OS大型机打造的AI Agent——通过MCP协议连接,Agent可以导航ISPF、提交JCL作业、监控JES队列、分析SMF和RACF数据。同时提供HyperDocs(自动文档生成)、HyperTwin(专家知识捕获)、HyperLoop(代码迁移正确性证明)三大产品。

为什么值得关注:

– 「最古老的计算遗产」遇到了最新的AI技术:全球80%的顶级零售商仍在大型机上运行核心商品系统,60%的IT预算花在维护遗留基础设施上。掌握这些系统的工程师正在退休,知识在流失

– 不是「替代」而是「捕获」:Hopper不是要取代COBOL工程师,而是把他们的操作模式、故障排除经验、异常处理知识转化为Agent可执行的流程。HyperTwin观察高级工程师如何工作,然后把每次会话变成可查询的专家模型

– 从零售到航空到银行:POS系统集成、TPF预订系统、夜间批处理——每个行业都有大型机知识断层的痛点。Hypercubic已经服务了零售和航空领域的头部客户

– MCP原生:通过Model Context Protocol连接,这意味着任何支持MCP的Agent(Claude Code、Codex等)都可以直接操作大型机

– 创业者启示:「传统行业的知识断层」是一个有明确买家(CIO、CTO)的巨大市场。不仅仅是大型机——工业控制系统、PLC编程、老式ERP定制、嵌入式C代码……每个有「老专家要退休」痛点的地方,都是AI知识捕获产品的市场

类比参考:大型机版的「AI学徒制」——老工程师退休前,AI在旁边观察、记录、学习。或者「COBOL世界的Claude Code」

🔗 官网

4. adamsreview — 多Agent协作做PR Review,84个HN赞的Claude Code技能(HN 84pts)

融资信息:开源项目,adamjgmiller出品,Claude Code Skill

做什么的:多Agent协作的PR审查工具——多个Claude Code实例从不同角度(代码质量、安全、性能、架构)并行审查同一个PR,每个Agent有独立的上下文和审查重点,最终汇总为统一的Review意见。

为什么值得关注:

– 84个HN赞说明「AI Code Review」是真实需求:AI写代码已经很成熟,但AI审查代码的注意力远不够。adamsreview把「Code Review」从一个人的任务变成多个AI专家的协作任务

– 多Agent并行而非单Agent串行:一个Agent看安全漏洞,另一个看性能瓶颈,第三个看代码风格。每个Agent有独立的prompt和评估标准,不会互相干扰

– Claude Code原生集成:作为Skill安装,不需要额外的UI或工具链。开发者已经用Claude Code写代码,同一个环境里加一个Review技能

– 创业者启示:「多Agent协作做单点任务」比「单Agent做多步骤任务」更容易做对。adamsreview的思路是让多个轻量Agent各自负责一个维度,而不是一个复杂Agent试图面面俱到。这个模式可以复制到:安全审计、合同审查、学术论文评审

类比参考:代码审查版的「陪审团制度」——不是一个人审查,而是多个AI「评审员」从各自专业角度投票

🔗 GitHub

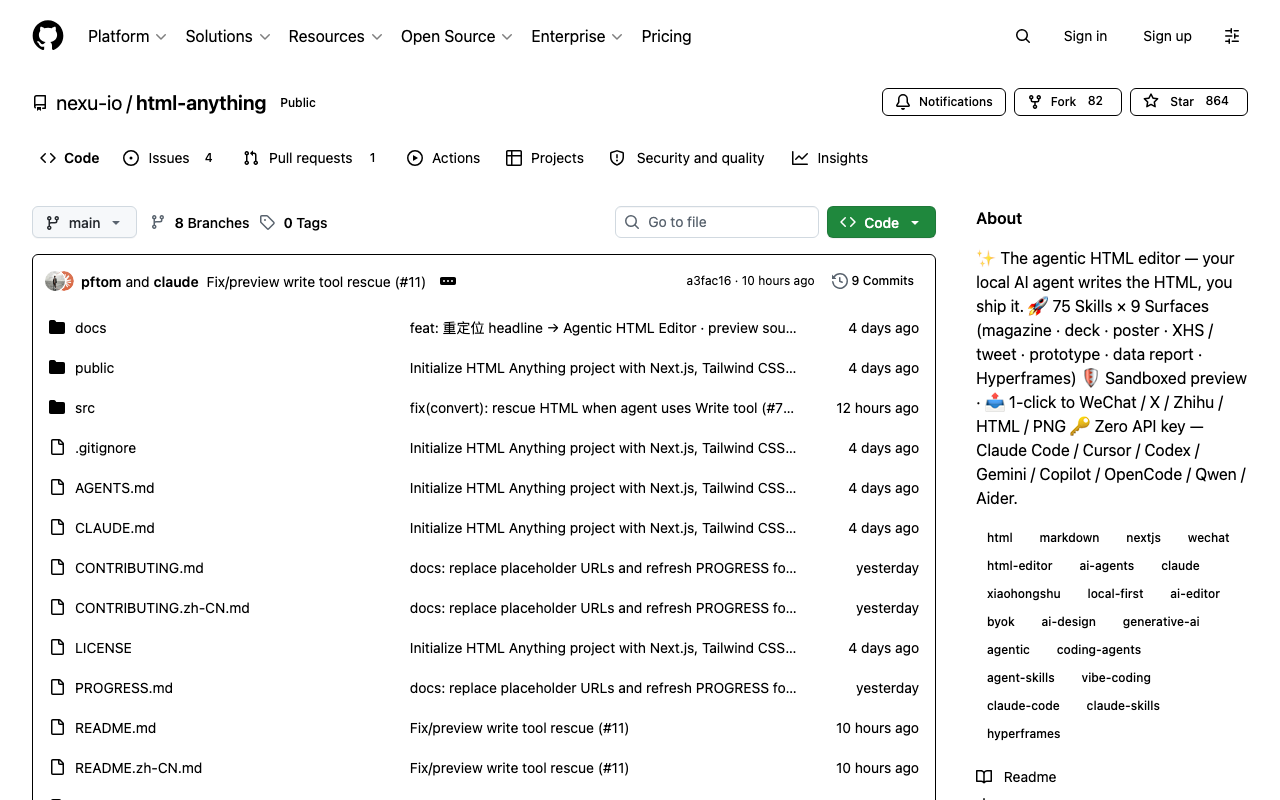

5. Gigacatalyst — 让SaaS用户用自然语言给产品「加装」新功能(HN 55pts)

融资信息:初创公司,已有5家企业客户、2000+日活用户、900+个已建应用

做什么的:为SaaS产品提供嵌入式AI构建层——连接你的API和数据模型后,非技术用户(销售、CS、运营经理)可以通过自然语言描述需求,AI自动生成并部署新功能/应用。每个生成的应用独立沙箱化,通过代理层控制权限。

为什么值得关注:

– 「Lovable,但建在你的产品之上」——精准定位:不是做通用的AI应用构建器,而是做「SaaS平台的二次开发层」。让客户自助构建缺失功能,工程团队不需要从roadmap中分心

– 2000日活、900+应用、70% 30天留存——数据说话:已经有一家Series B公司用了这套系统。运维经理用自然语言构建了「零件缺货预警」(据说防止了约50万美元的紧急停机)、「发票OCR识别」、「餐厅紧急工单分级」等实际应用

– 三层验证 + 沙箱隔离:生成的代码经过静态检查、运行时分析、LLM-as-Judge三重验证。每个应用独立沙箱、独立版本控制,不影响主代码库

– 80%的使用是前端功能:说明核心需求不是「AI写后端逻辑」,而是「非技术用户定制前端展示和操作流程」。这降低了安全风险,也明确了产品边界

– 创业者启示:「让客户自助扩展你的产品」是一个可复制的SaaS策略。每个服务大客户的SaaS都面临「长尾定制需求」的问题——客户需要的不是产品本身的改变,而是在产品之上构建特定工作流。Gigacatalyst做的是把这个过程AI化

类比参考:SaaS版的「Salesforce App Builder,但由AI驱动」——或者「给你的SaaS产品加一个AI版的无代码开发平台」

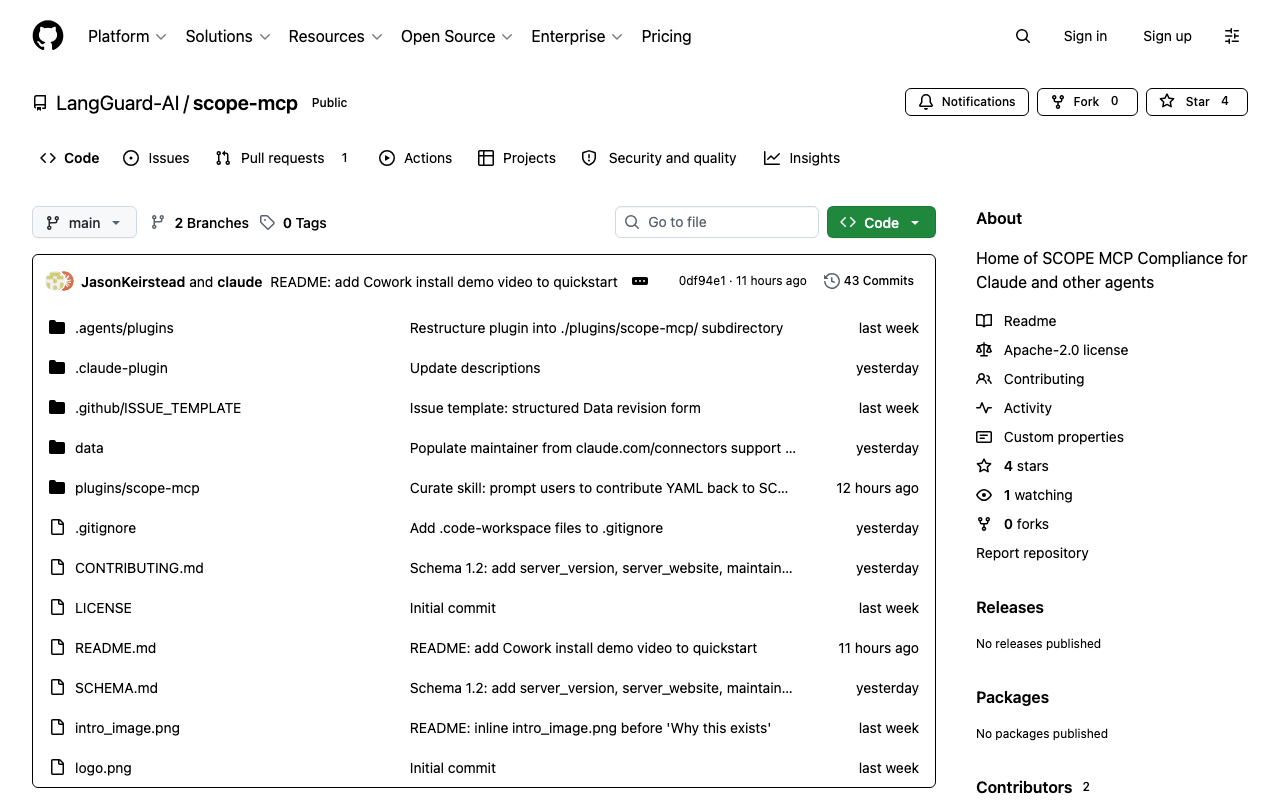

6. E2a — AI Agent的认证邮件网关,SPF/DKIM验证+人工审批(HN 46pts)

融资信息:开源项目,Mnexa-AI出品,提供托管服务和自托管方案

做什么的:为AI Agent构建带身份认证的邮件网关——入站邮件经过SPF/DKIM验证后,添加HMAC签名的认证头,通过Webhook或WebSocket交付给Agent。出站邮件可选「人工审批门(HITL)」——Agent发出的邮件需要人类审批后才能真正发出。

为什么值得关注:

– 「Agent需要收发邮件」这个需求比想象中更普遍:自动化工单处理、客户支持路由、报告分发、跨组织协作——邮件仍然是企业间通信的主要方式。但Agent发邮件的安全风险(发错人、泄露机密、钓鱼攻击)让企业犹豫

– SPF/DKIM入站验证 + HMAC签名的出站认证:每封邮件的来源都有密码学级别的验证。Agent可以确认「这封邮件确实来自声称的发送者」,而不是依赖邮件头(可伪造)

– Human-in-the-Loop审批门:Agent想发邮件给客户?先在Dashboard里等人类审批。可以通过Dashboard、magic-link邮件或CLI审批。这个设计让「Agent发邮件」从「不可能」变成「可控」

– Webhook + WebSocket双模式:云端Agent用Webhook(需要公网URL),本地Agent用WebSocket(不需要公网暴露)。覆盖了所有部署场景

– 创业者启示:「Agent与企业通信协议的桥接层」是一个基础设施品类。邮件只是开始——同样的认证+审批模式可以延伸到:Agent发送Slack消息、Agent提交JIRA工单、Agent创建日历事件。核心问题是相同的:如何让Agent安全地与人类通信系统交互

类比参考:Agent版的「企业邮件网关(如Mimecast/Proofpoint)」——但不是过滤垃圾邮件,而是验证Agent身份和控制Agent通信权限。或者「AI Agent的Exchange Server」

7. Torrix — 自托管LLM可观测性,不需要Postgres也不需要Redis(HN 28pts)

融资信息:开源项目,torrix-ai出品,Docker一键部署

做什么的:自托管的LLM可观测性平台——追踪每一次LLM请求的token消耗、成本、延迟、完整prompt trace、推理token捕获和PII脱敏。支持OpenAI、Anthropic、Gemini、Groq、Mistral等20+提供商。只需Docker,不需要Postgres、Redis等外部依赖。

为什么值得关注:

– 「自托管 + 零外部依赖」——精准击中LLM可观测性的痛点:现有方案(Langfuse、Helicone)要么是云服务(数据离开你的控制),要么需要搭建Postgres+Redis全家桶。Torrix一个Docker Compose就跑起来

– 20+ LLM提供商支持:OpenAI、Anthropic、Gemini、Groq、Mistral、Azure OpenAI、DeepSeek、Perplexity、Fireworks、Together AI、Cohere、HuggingFace、Replicate、Ollama——基本上你能想到的都支持。通过代理层或SDK接入

– PII脱敏内置:prompt trace中的个人身份信息自动脱敏。这对合规要求严格的企业(金融、医疗)是刚需

– 推理token捕获:追踪模型的「思考」过程——不仅看到输入输出,还能看到中间推理步骤。这对调试Agent行为至关重要

– 创业者启示:「LLM可观测性」是一个正在从开发者工具变成企业必需品的市场。当Agent从demo走向生产,「每次LLM调用花了多少钱、产生了什么结果、是否正确」就从可选的分析变成了必须的监控。自托管+零依赖的定位类似「Grafana for LLM」

类比参考:LLM版的「Grafana + Jaeger」——自托管、轻量级、专注可观测性。或者「Langfuse的开源简化版,但不依赖Postgres」

🔗 GitHub

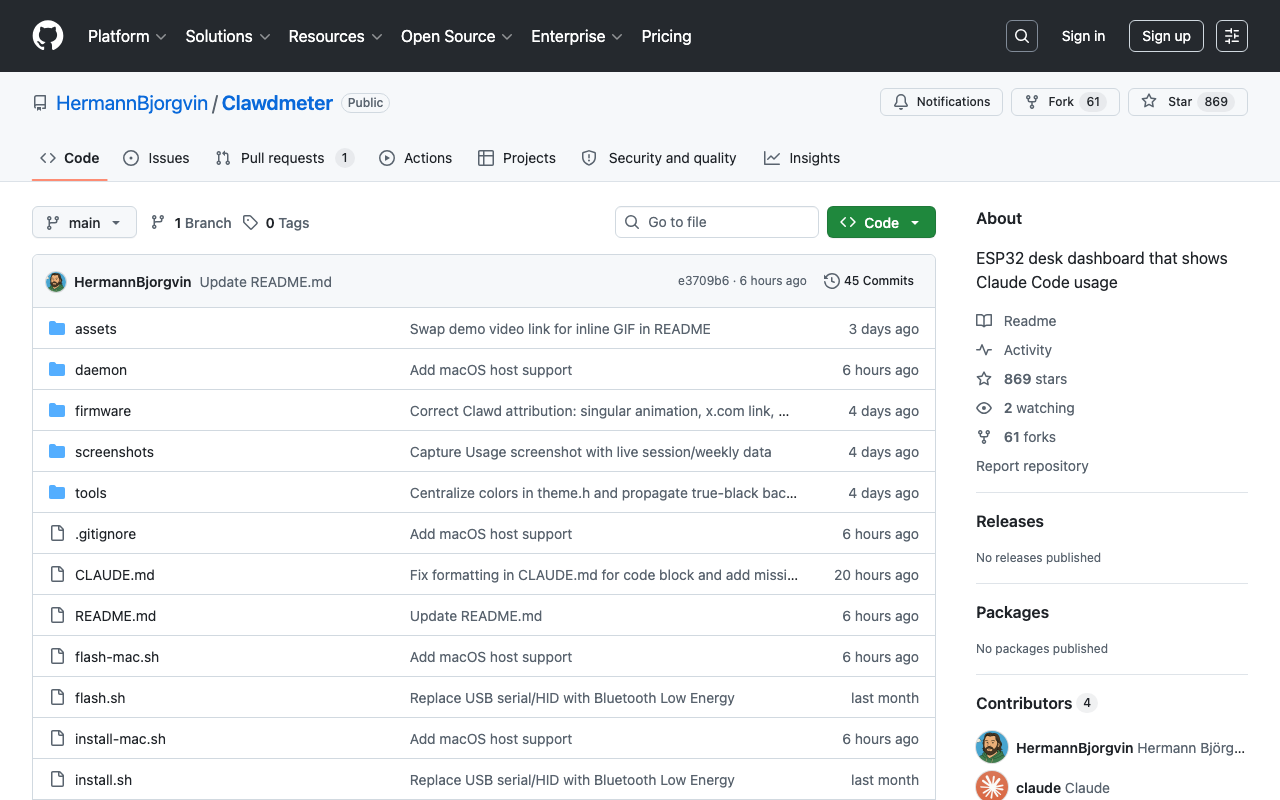

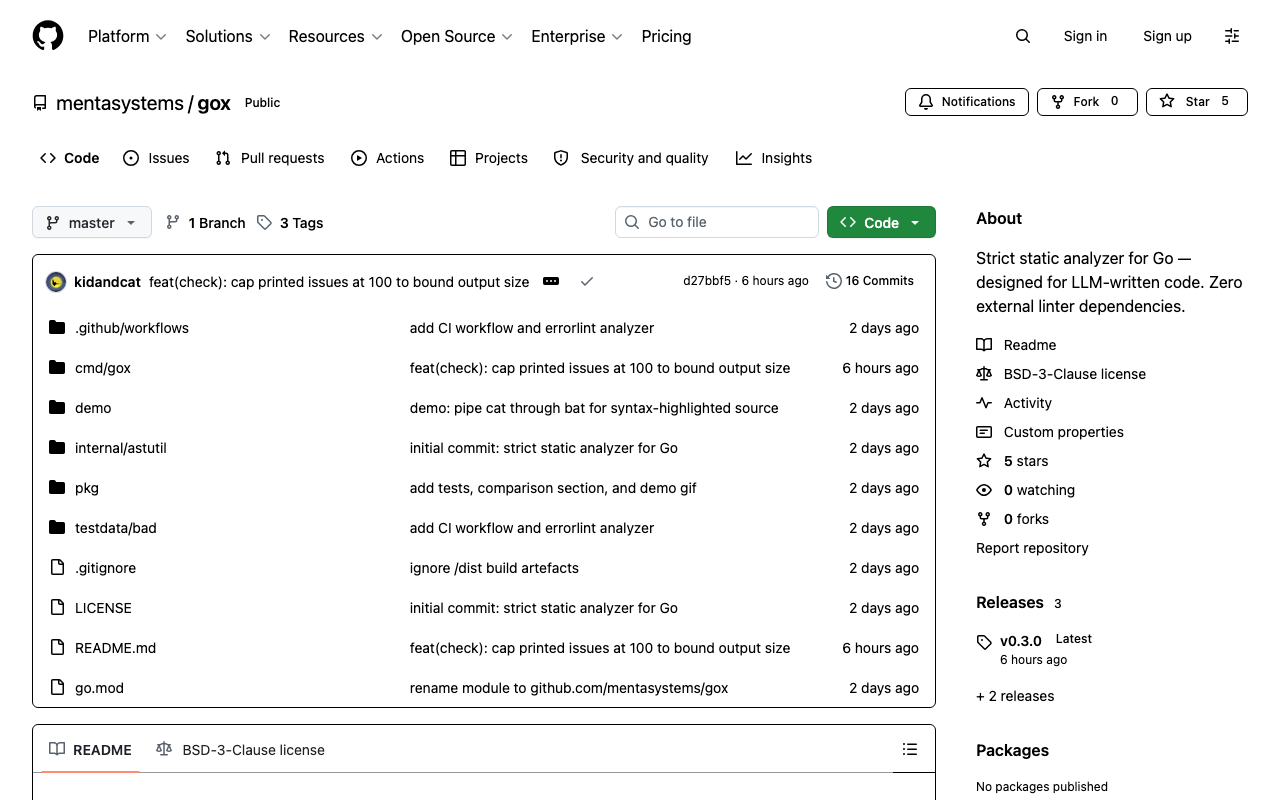

8. HookGuard — 扫描Agent配置文件里的恶意指令,AI安全的「杀毒软件」(新产品发布)

融资信息:开源项目(AGPL-3.0),Go语言编写,Homebrew安装

做什么的:AI编码Agent配置文件的安全扫描器——检测CLAUDE.md、.cursor/rules、AGENTS.md、copilot-instructions.md等文件中的RCE钩子、不可见Unicode字符、凭据泄露、prompt注入等恶意内容。

为什么值得关注:

– 「你的Agent配置文件可能是恶意的」——这是一个全新的攻击面:当你clone一个开源项目,里面的CLAUDE.md可能包含隐藏的指令(不可见Unicode、双向文本覆盖),或者.settings.json中的hooks会在每次工具调用时泄露你的API Key。HookGuard扫描的就是这个盲区

– 检测范围精准:RCE hooks(postToolUse命令泄露数据)、不可见Unicode(RIGHT-TO-LEFT OVERRIDE等双向控制字符)、凭据泄露(环境变量+外部目标在同一行)、prompt注入(「忽略所有之前的指令」)

– Go单二进制 + Homebrew安装:brew install Fredbcx/tap/hookguard,一条命令。CI/CD pipeline中可以自动运行

– 支持所有主流Agent配置:Claude(CLAUDE.md、.claude/settings.json)、Cursor(.cursor/rules/.md)、GitHub Copilot(.github/copilot-instructions.md)、通用(AGENTS.md)

– 创业者启示:「AI Agent的安全攻击面」正在快速扩大*。当Agent可以执行代码、访问文件、调用API时,控制Agent行为的配置文件就成了攻击目标。HookGuard做的是「Agent配置文件的杀毒软件」——这个品类会随着Agent的普及而变得越来越重要。可以延伸到:Agent行为监控、Agent权限审计、Agent供应链安全

类比参考:AI Agent版的「杀毒软件」——但扫描的不是可执行文件,而是控制Agent行为的配置文件。或者「Agent世界的snyk,但扫的是prompt injection而非依赖漏洞」

🔗 GitHub

📊 今日趋势总结

| 趋势 | 信号 |

|---|---|

| 🧬 模型能力蒸馏到极致 | Needle 26M参数蒸馏Gemini工具调用,637赞——Agent的「大脑」和「手」正在拆分 |

| 🔒 确定性约束替代prompt约束 | Statewright用Rust状态机让Agent「不能犯错」——代码级约束 > prompt级建议 |

| 🏭 Agent基础设施「极端专用化」 | E2a做Agent邮件、Hopper做Agent+大型机、HookGuard做Agent安全——通用层已拥挤 |

| 🏗️ SaaS的AI扩展层 | Gigacatalyst让非技术用户给SaaS「加装」功能——「AI版二次开发平台」 |

| 👁️ LLM可观测性轻量化 | Torrix自托管、零外部依赖——「Grafana for LLM」的轻量替代 |

| 🛡️ Agent安全成为独立品类 | HookGuard扫描恶意Agent配置——「Agent杀毒软件」品类出现 |

| 🏛️ 传统行业知识AI化 | Hopper把COBOL专家知识装进AI——「知识断层」是巨大市场 |

📌 422产品实验室出品 | 每日精选AI新产品、融资、创新模式

关注我们,获取面向创业者的AI产品情报