Hi,早上好,好久不见。

我是洛小山,和你聊聊 AI 应用。

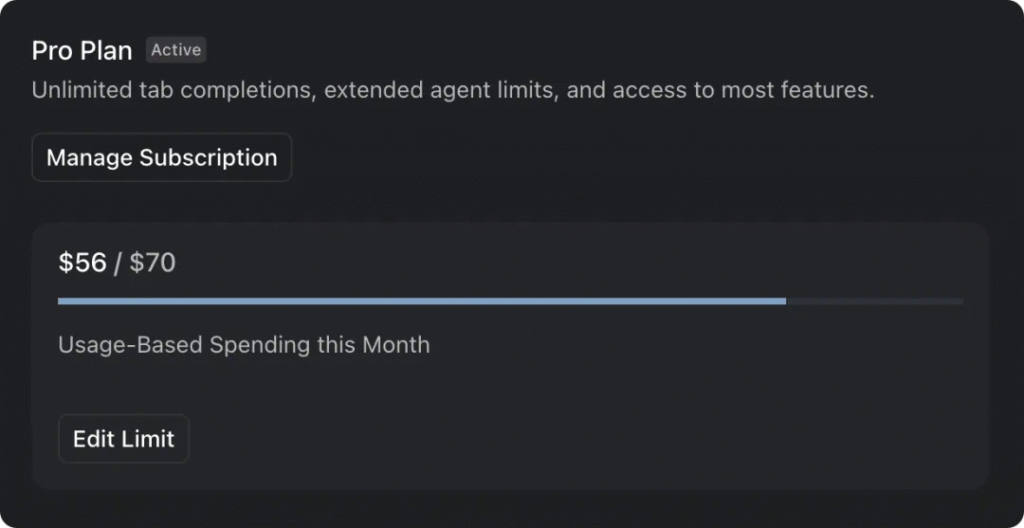

最近沉迷 Claude Code 无法自拔,但Claude 账号不但花钱如流水,还被封了俩。

我用 Qwen 和 Kimi 作为平替,Qwen 的钱花了特别特别多。

最近,朋友他们公司希望让员工都用 Claude Code,但很担心公司内代码泄露,问我有没有什么办法。

同时,我也很好奇:Claude Code 的提示词是啥?

周末花了 56 刀,肝了一个Claude Code API 私有化部署平台。

一句话:Claude Code 能用任何模型了。

这个平台不但能直接夺舍,套Claude Code 提示词,还能使用私有化部署的模型。

在飞机上,没有网络,也能用笔记本跑 Qwen Coder!

这个平台,我起名为红狼。

这个工具有什么用?

红狼最大的价值就是让 Claude Code (下文称之为 CC)能够使用任何大模型,实现最大成本节约和智能化管理。

这样做的好处是什么?

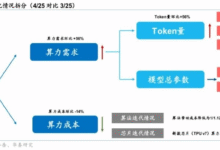

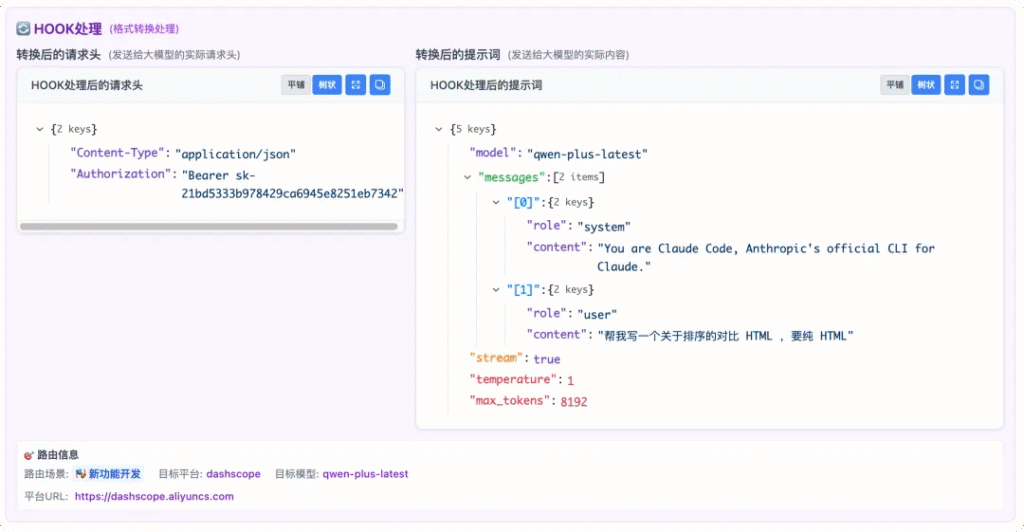

Claude Code 的系统提示词 token 特别多,如果每次简单的问候都用大模型处理,成本高得离谱。

比如,你和 Claude Code 说“你好”的时候,系统智能识别这是简单对话,自动路由到便宜的小模型;

当你让它写复杂代码时,系统又会智能切换到 Qwen Coder 或者 K2、GLM-4.5 这样的编程模型;

而当你需要高级修改的时候,它才会调用血贵的 Claude-Sonnet-4。

红狼通过智能路由,能根据任务复杂度自动选择合适规模的模型,避免大材小用(主要是为了省钱)。

你甚至可以自己在本地部署一个 Coder 模型,让 CC 直接用本地模型。

这就能让你在没有网络的情况下继续快乐编程。

红狼这个特性对企业用户来说,优势就是支持完全私有化部署。

你可以在公司内部部署大尺寸的 Coder 模型(比如480B参数的模型),这样代码永远不会泄露给 Qwen、Kimi 这些外部服务,同时还能给你们公司的员工提供Claude Code 服务。

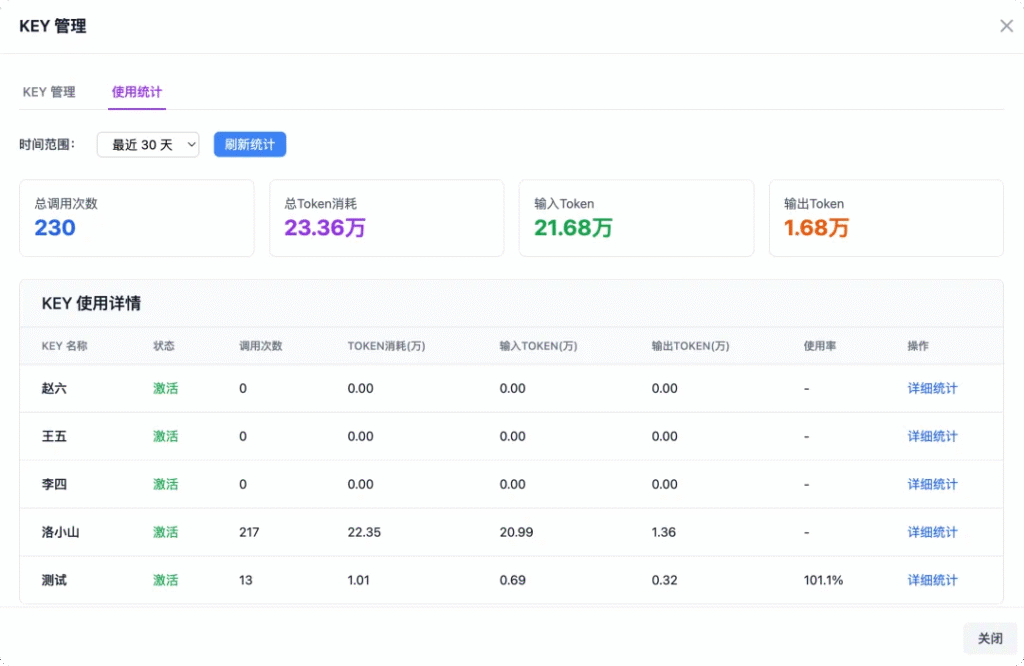

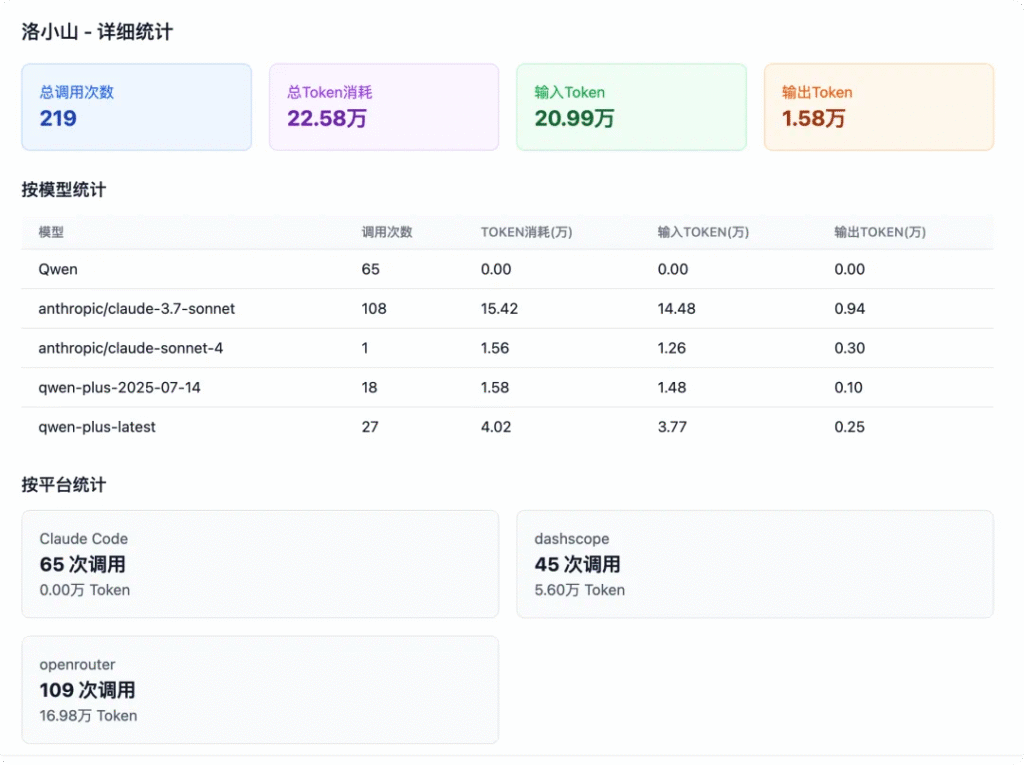

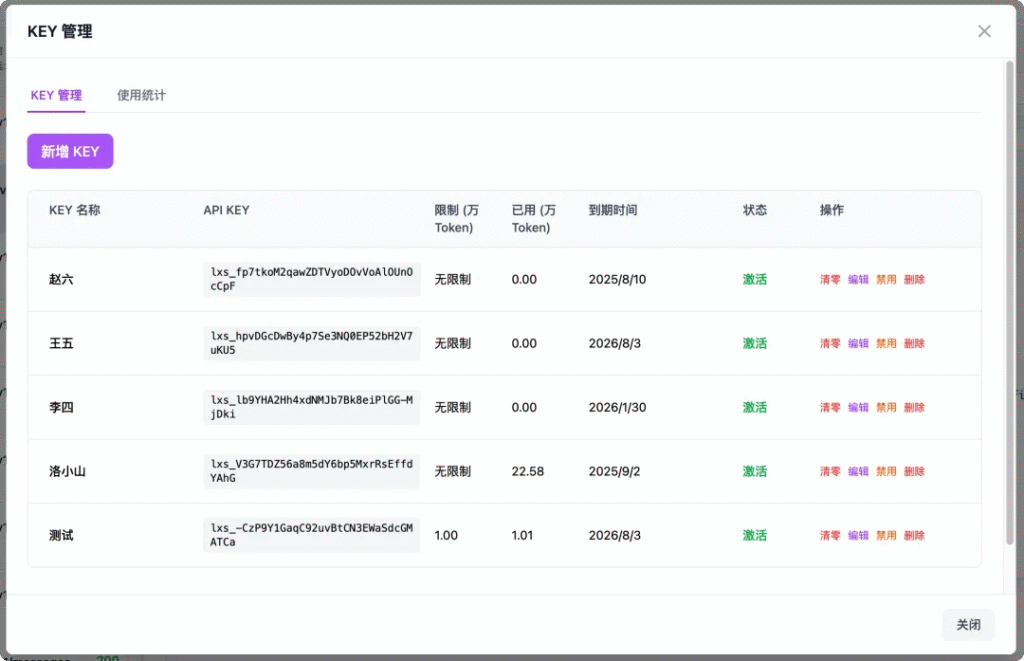

平台支持你创建任意多个 KEY,每个 KEY 单独计算消耗,也可以显示消耗量。

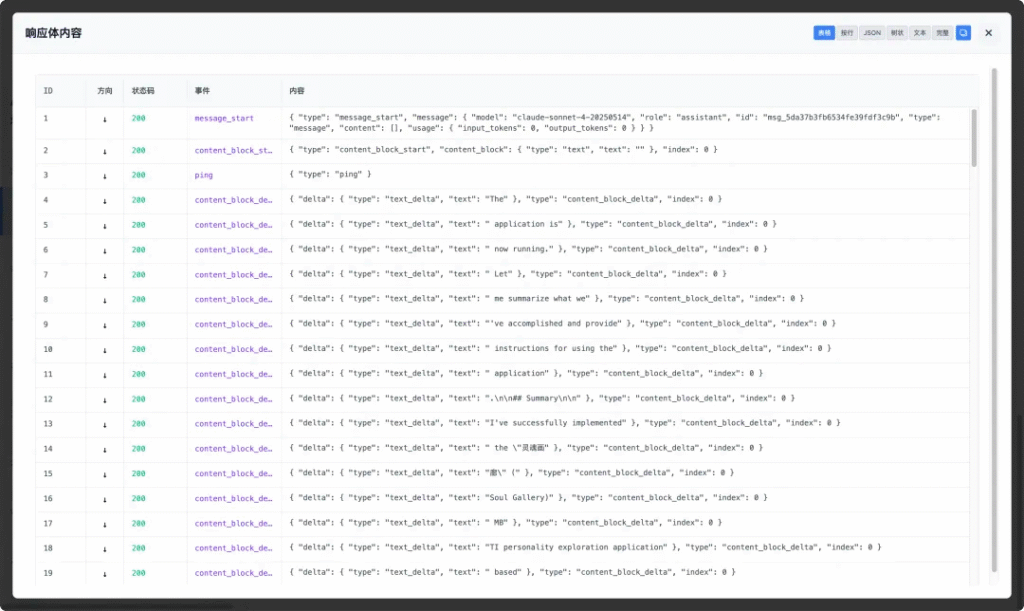

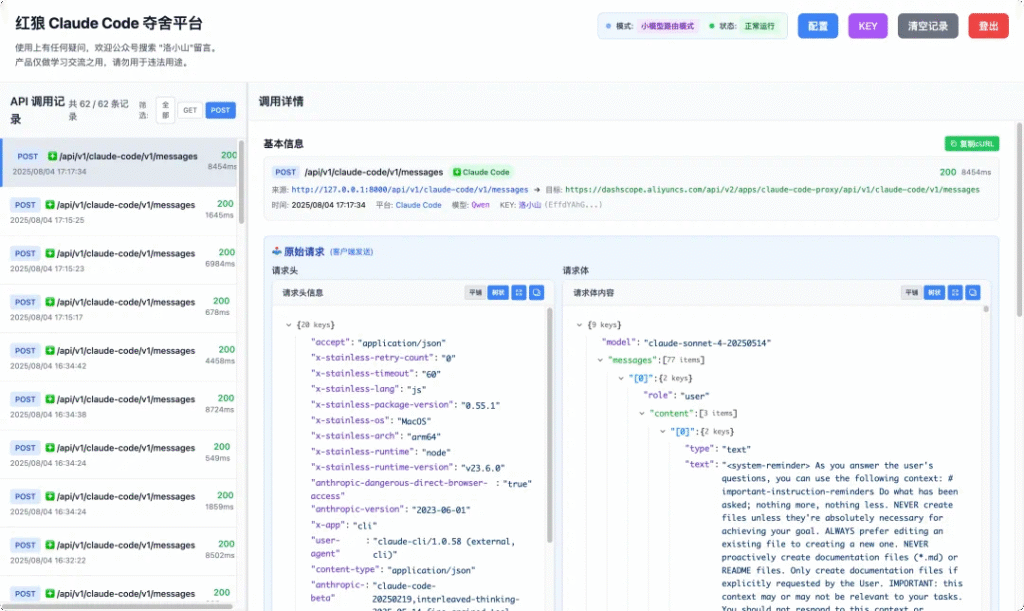

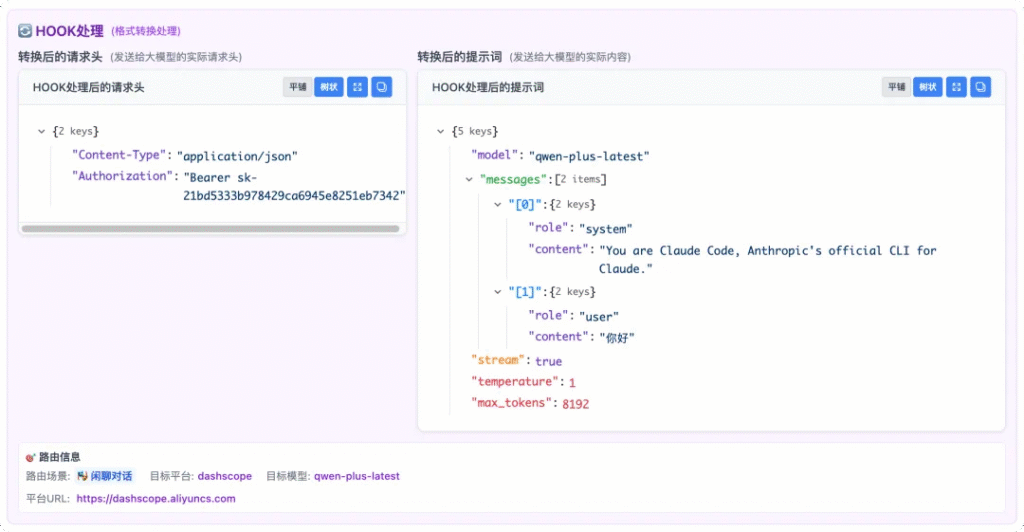

另外,你也和我一样好奇, CC 的提示词是什么,这个系统能直接抓到。

平台有丰富的请求体详情界面。

Ps. 在互联网上…这玩意叫中间人攻击~

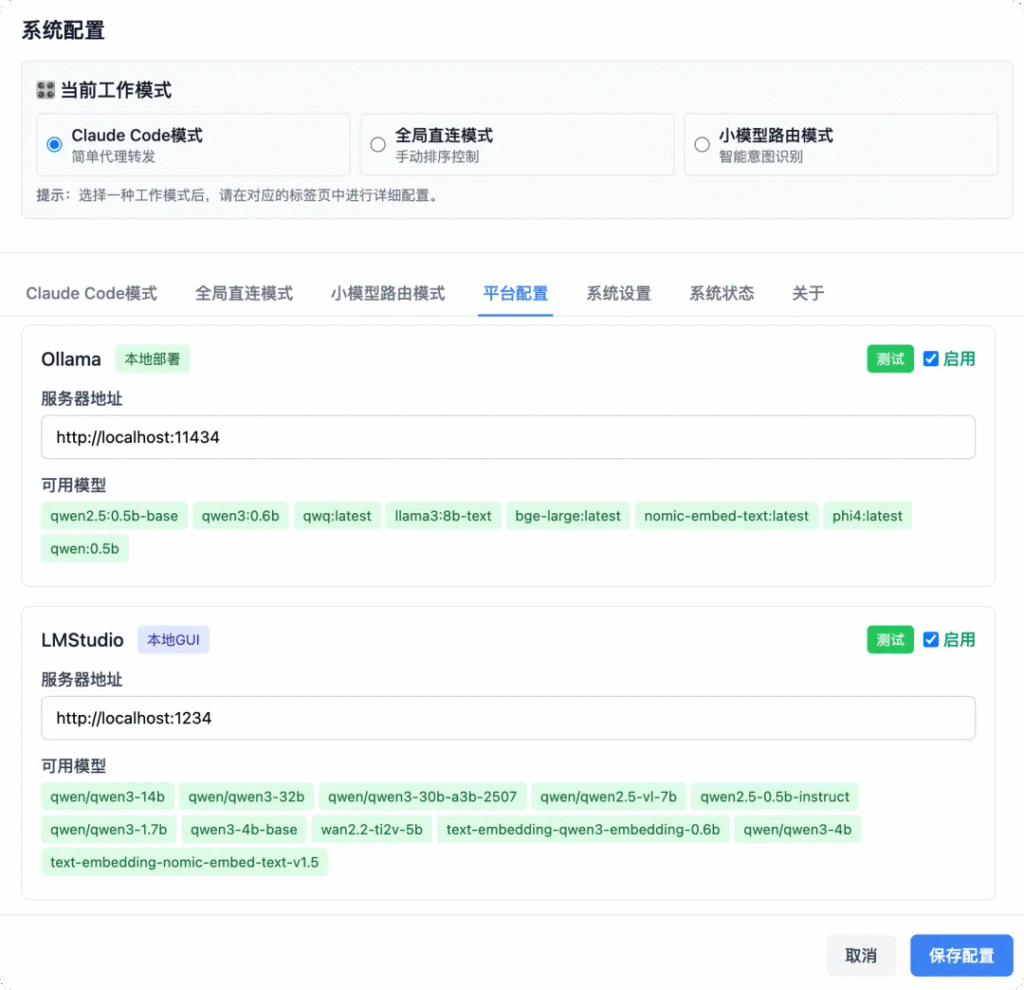

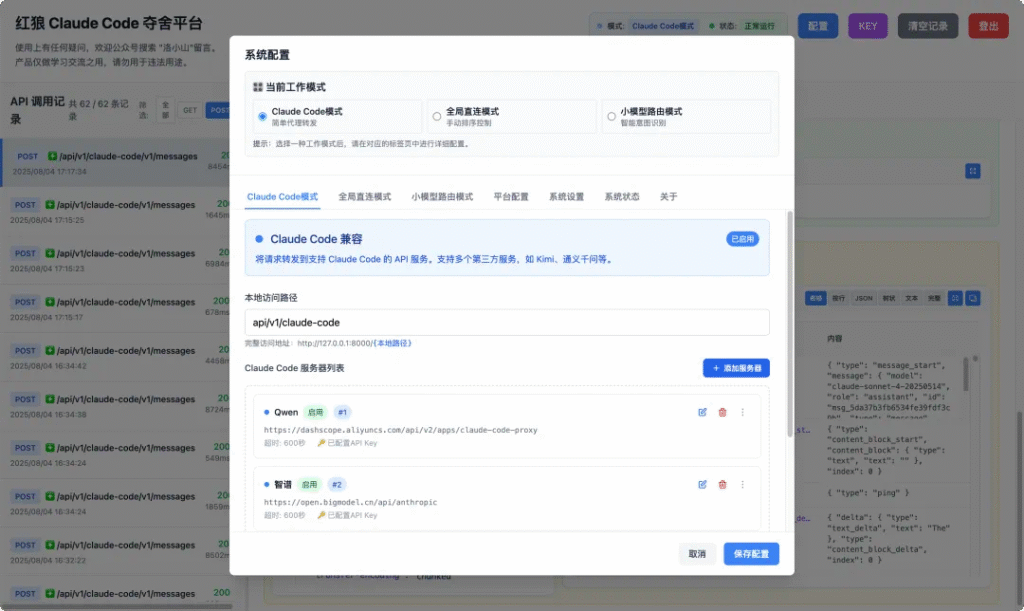

三种工作模式,适应不同需求

红狼提供了三种工作模式。

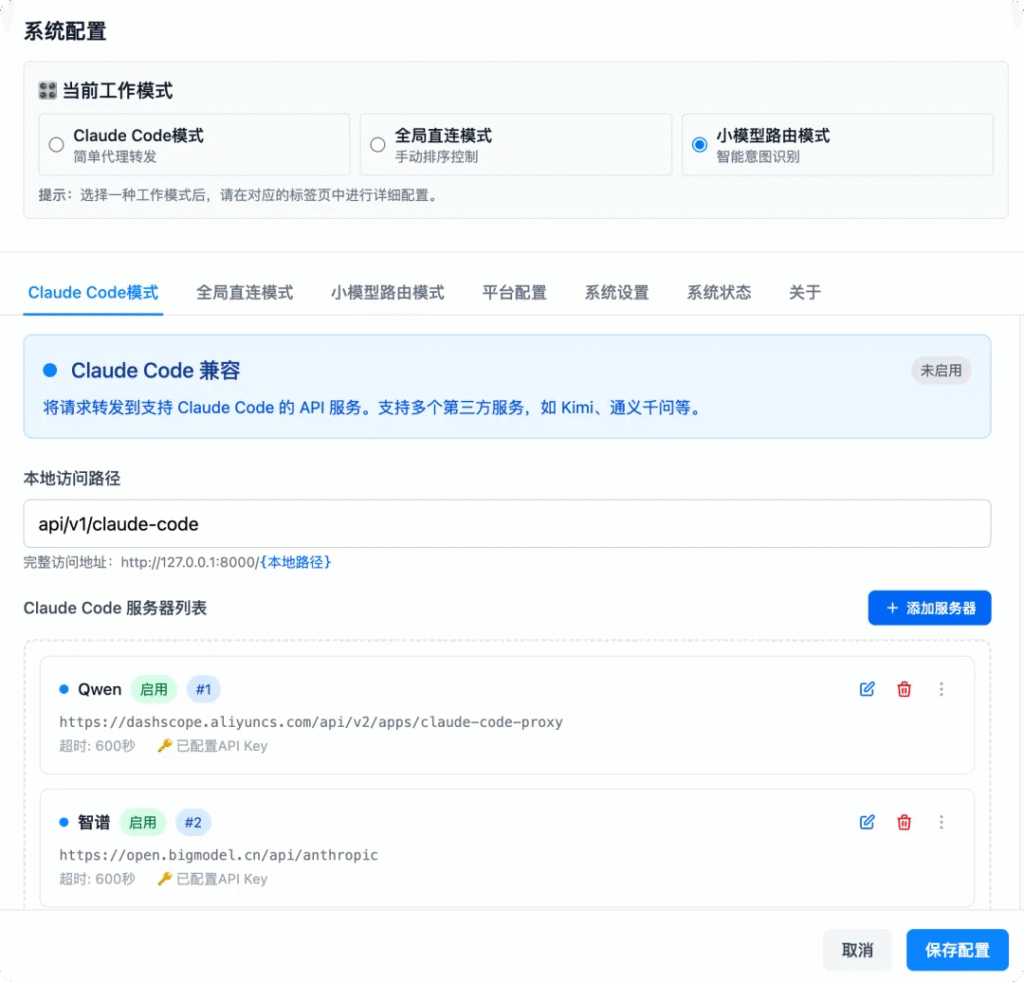

Claude Code 兼容模式是最简单的,就是简单的代理转发,适合已经有CC服务但想要捕获和分析 Prompt 的用户。

这个模式可以记录所有经过的提示词,让你分析CC到底是怎么工作的。

你还能同时使用多个 Claude Code API,在一个不可用(没钱)的时候,自动降级到备胎模型。

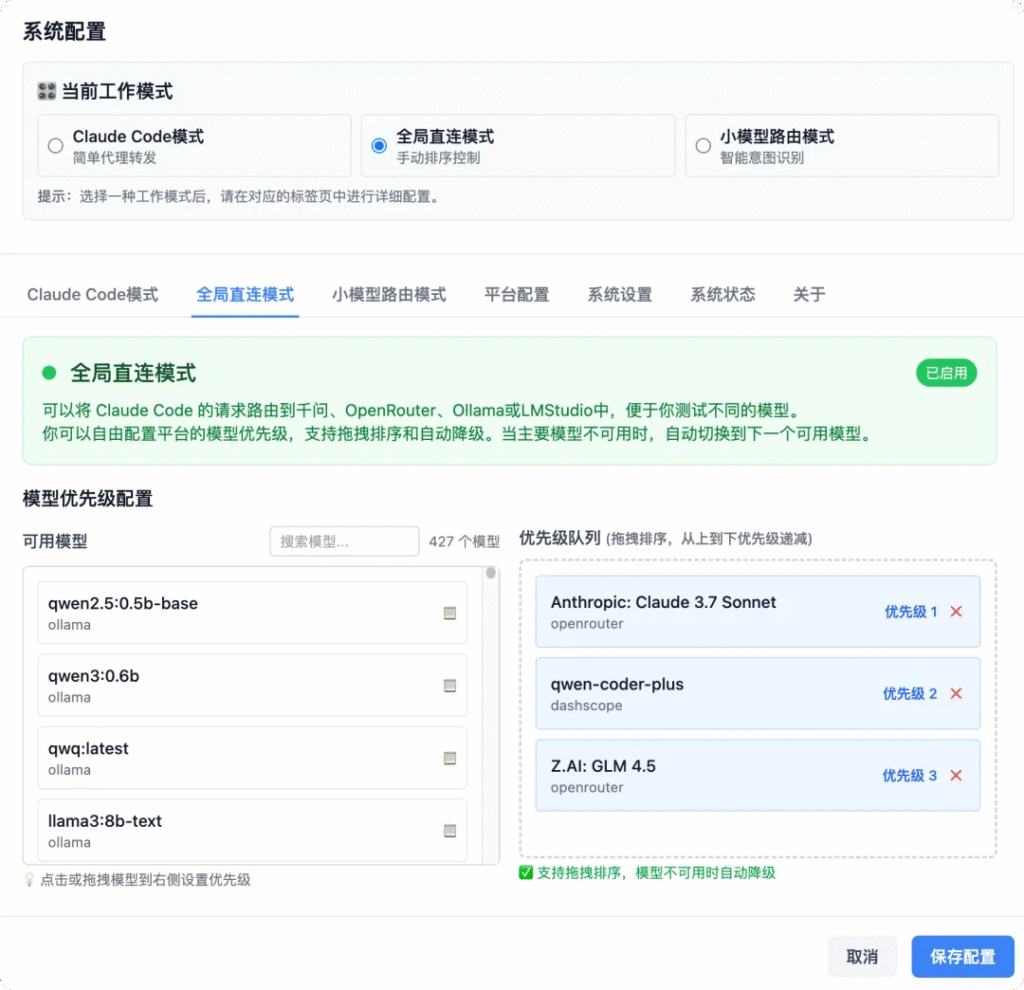

全局直连模式比较适合新手,你可以手动设置模型的优先级顺序,系统会按照你设定的顺序尝试调用模型。

界面支持拖拽排序,操作很直观。

智能路由模式是最高级的功能,系统会用小模型(比如 Qwen -Turbo)或者本地的小模型,分析析用户的意图,然后智能选择最适合的大模型来执行任务。

比如你说”帮我写个排序算法”,小模型识别出这是代码创建任务,就会路由到 Qwen Coder;

如果你问”为什么这段代码会出错”,系统识别出这需要逻辑分析,就会调用 Claude-Sonnet-4。

支持多平台,本地云端都能用

红狼支持阿里云百炼的通义千问系列,OpenRouter 可以访问各种开源和商业模型,Ollama 和 LMStudio 让你在本地跑开源模型。

你可以根据需求灵活搭配,重要代码用本地模型保证安全,一般任务用云端模型提高效率。

系统还有完整的容错机制,主模型不可用时会自动切换到备用模型,支持多服务器轮询,确保服务的高可用性。

而且所有的 API 调用都有详细的监控记录,包括 Token 使用统计、响应时间、调用频次等,方便你进行成本分析和性能优化。

安全和用户管理

红狼有完整的安全认证系统,支持密码认证和会话管理。

我提供了用户 KEY 管理功能,你可以为团队成员分配不同的 API KEY,设置 Token 使用限制和到期时间,你可以查看每个用户的详细使用统计。

你甚至可以部署完了之后…卖这个 KEY …

做 Claude Code 的二手集成商…

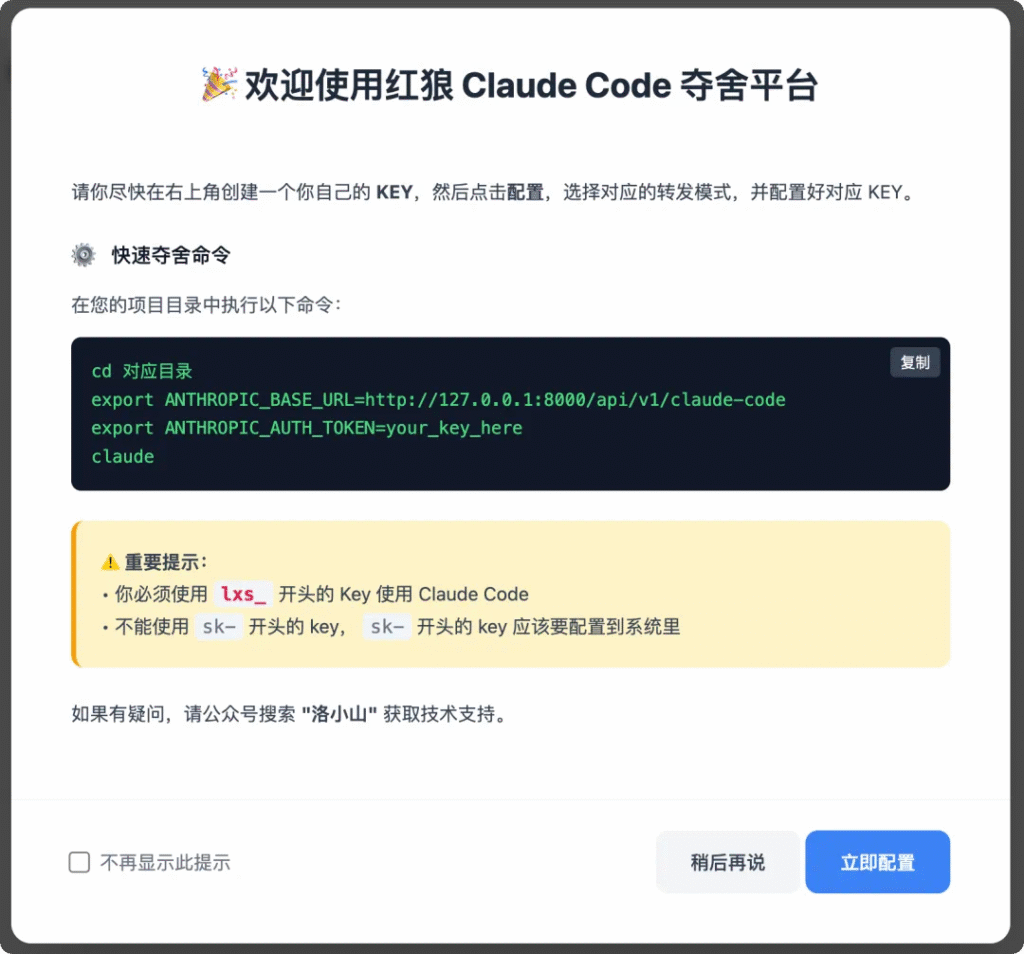

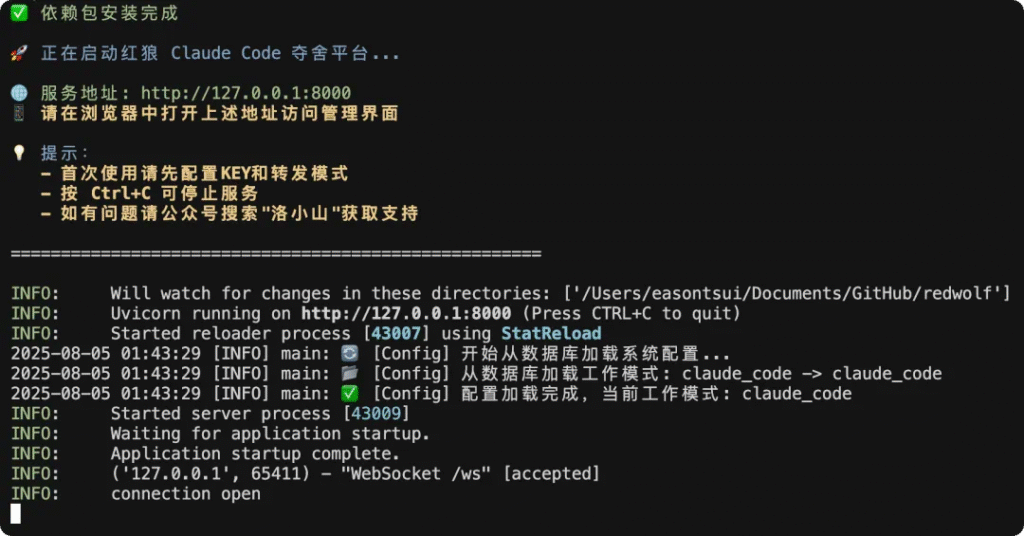

超级简单的使用方式

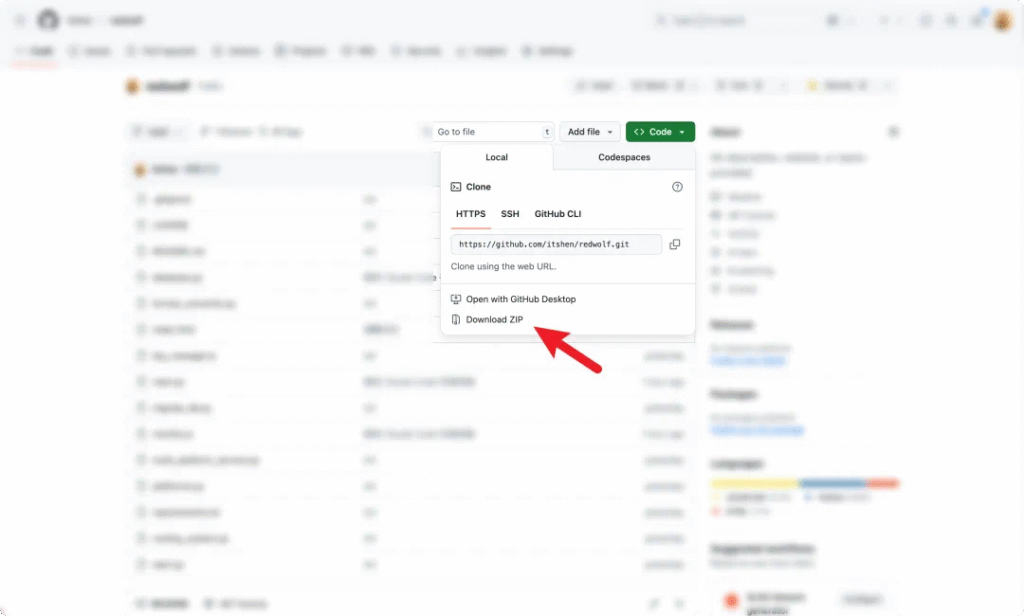

Github 访问:github.com/itshen/redwolf

点击下载压缩包

下载或者克隆到本地,解压缩。

运行 启动.bat 或者 启动.sh 即可。

然后访问:127.0.0.1:8000,登录。

初始密码是 admin

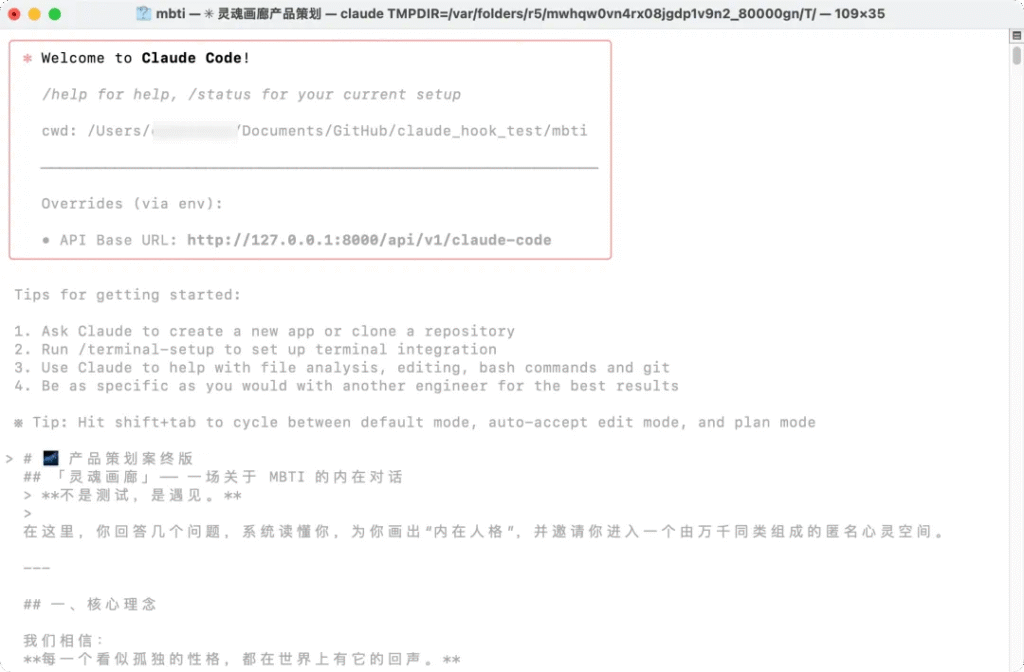

接着配置至少一个平台(比如阿里云百炼或者本地的 Ollama),最后设置 Claude Code 的环境变量就能用了。

export ANTHROPIC_BASE_URL=http://127.0.0.1:8000/api/v1/claude-code

export ANTHROPIC_AUTH_TOKEN=your_key_here

claude就这么简单,你的 Claude Code 就能使用各种大模型了。

典型使用场景

- 个人:可以用红狼替代血贵的 Claude API,用本地模型或低价云端模型,降低成本。

- 团队:支持本地与云端模型混合部署,灵活权衡效果与成本。还可实现完全私有化部署,保证代码安全性。

- 研究:可以分析 Claude Code 的 Prompt 模式,帮助理解和改进 CC的工作机制。

最后,这个工具解决了我使用 Claude Code 时最头疼的两个问题:成本高 和 数据不安全。

项目已开源在 GitHub: github.com/itshen/redwolf

现在还有一些 BUG ,不过我会持续修复。

欢迎大家试用、提意见!如果有用,记得点个 Star!

那么,我们下次见~

点击原文,可以跳转到 Github 仓库。